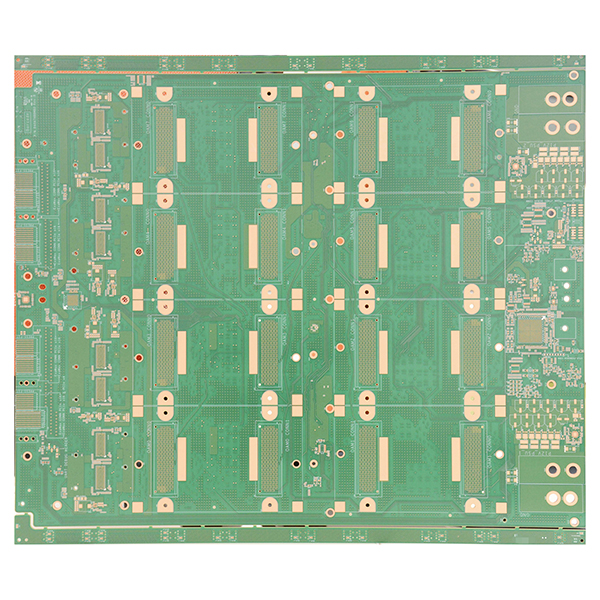

realizzazione della scheda di base universale UBB per l’interconnessione degli acceleratori

Nei server AI, la scheda madre UBB non solo funge da supporto per la piattaforma GPU e consente una trasmissione e uno scambio di dati efficienti, ma, grazie alle sue elevate prestazioni, all’alta stabilità e alla scalabilità, diventa anche il supporto principale per l’infrastruttura di elaborazione AI.

Descrizione

Definizione della scheda AI UBB

L’AI UBB, Universal Base Board, è una scheda madre o backplane di fascia alta progettata per fornire alimentazione, segnali, gestione e canali di interconnessione ad alta velocità per le schede di accelerazione AI come i moduli OAM, le GPU e gli FPGA. In genere funge da piattaforma di interconnessione centrale nei server AI o negli chassis degli acceleratori AI, come NVIDIA HGX, Baidu Kunlun e Alibaba Hanguang, rendendola una base hardware fondamentale per i moderni centri di elaborazione AI.

Funzioni principali della scheda UBB AI

- Consente l’interconnessione ad alta velocità tra più schede di accelerazione AI e la CPU host, nonché tra le schede di accelerazione, supportando protocolli come PCIe, NVLink e CXL.

- Fornisce funzioni unificate di distribuzione dell’alimentazione, interfacce di raffreddamento, distribuzione dei segnali di gestione e monitoraggio dello stato di salute.

- Supporta vari tipi di moduli acceleratori AI, offrendo un’elevata compatibilità e una scalabilità flessibile.

- Garantisce percorsi di dati ad alta larghezza di banda e bassa latenza per uno scambio e una trasmissione efficienti dei dati.

Caratteristiche principali della fabbricazione di PCB UBB AI

- Numero di strati ultraelevato (≥20 strati), grandi dimensioni (generalmente superiori a 400×500 mm) e spessore della scheda ≥3 mm.

- Utilizza materiali di alta qualità a bassissima perdita per soddisfare i requisiti di trasmissione dei segnali ad alta frequenza.

- Impiega processi avanzati come la retroforatura, i vias riempiti di resina e il POFV, con un foro minimo di 0,2 mm e un rapporto di aspetto ≥15.

- Alta densità di tracce fino a 0,09/0,09 mm, con una precisione di controllo dell’impedenza che raggiunge il ±8%.

- Supporta moduli ad alta potenza e sostituibili a caldo, con forti capacità di raffreddamento e gestione dell’alimentazione.

- Design altamente personalizzato con affidabilità e stabilità eccezionali, adatto all’implementazione di cluster AI su larga scala.

Principali applicazioni della scheda UBB AI

- OAM, Open Accelerator Module, architettura di server AI, che funge da ponte tra i moduli OAM e la scheda madre/CPU.

- Backplane centrale per piattaforme server AI come NVIDIA HGX, che fornisce l’interconnessione per più GPU/schede acceleratrici AI.

- Server AI ad alte prestazioni con raffreddamento a liquido o ad aria, che consentono l’espansione modulare e la gestione di cluster AI ad alta densità e potenza di calcolo.

- Utilizzati in centri di supercomputing, data center e piattaforme di cloud computing AI su larga scala per applicazioni AI di fascia alta.

Differenze rispetto ai backplane tradizionali

- Le schede UBB sono progettate specificamente per l’ecosistema degli acceleratori di intelligenza artificiale e supportano una maggiore larghezza di banda (come PCIe Gen4/Gen5, NVLink, CXL) e requisiti di potenza più elevati.

- Maggiore attenzione all’espansione flessibile e alla diversa compatibilità tra i moduli AI, in modo da poter gestire la rapida evoluzione della tecnologia e dell’hardware AI.

- Fornisce una maggiore integrità del segnale e affidabilità del sistema, rendendolo un componente indispensabile per le piattaforme di elaborazione AI su larga scala.

English

English  Français

Français  Tiếng Việt

Tiếng Việt  Italiano

Italiano  Nederlands

Nederlands  Türkçe

Türkçe  Svenska

Svenska  Polski

Polski  Română

Română  Latviešu

Latviešu  한국어

한국어  Русский

Русский  Español

Español  Deutsch

Deutsch  Українська

Українська  Português

Português  العربية

العربية  Indonesian

Indonesian  Čeština

Čeština  Suomi

Suomi  Eesti

Eesti  Български

Български  Dansk

Dansk  Lietuvių

Lietuvių  Bokmål

Bokmål  Slovenčina

Slovenčina  Slovenščina

Slovenščina  Ελληνικά

Ελληνικά  Magyar

Magyar  עברית

עברית